A Polêmica Militarização da Inteligência Artificial nos EUA

Atualmente, os Estados Unidos estão imersos em um acalorado debate ético sobre o uso da inteligência artificial (IA) nas aplicações militares. Essa discussão se intensificou ainda mais com a recente tensão entre o governo do presidente Donald Trump e a startup de IA americana Anthropic, que se viu no meio de um impasse devido a sanções impostas pelo governo.

A Anthropic tem se recusado a permitir que suas tecnologias sejam utilizadas pelas Forças Armadas dos EUA sem restrições, algo que o governo exige. O objetivo do governo é claro: eles desejam implementar essa tecnologia para vigilância em massa da população e, em um cenário ainda mais alarmante, automatizar bombardeios que poderiam ter consequências mortais para civis e militares.

Contexto da Tensão

Segundo várias fontes de notícias, os modelos tecnológicos desenvolvidos pela Anthropic foram utilizados na preparação de uma ofensiva israelense-americana contra o Irã, que levou a uma escalada de conflitos no Oriente Médio. Isso levanta questões sérias sobre o impacto da IA na segurança global e na soberania das nações. Jiang Bin, porta-voz do Ministério da Defesa da China, expressou preocupações sobre a militarização da IA, afirmando que “continuar a militarização desenfreada da inteligência artificial, usá-la como ferramenta para violar a soberania de outras nações, permitir que influencie indevidamente decisões de guerra e deixar que algoritmos exerçam poder de vida ou morte sobre seres humanos” não é apenas antiético, mas pode levar à perda do controle tecnológico.

Referência ao Cinema e à Ficção Científica

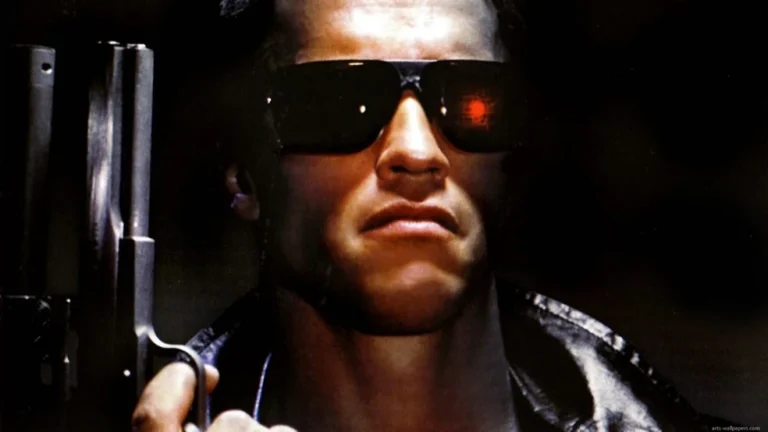

Ainda mais intrigante é a comparação que ele faz com a famosa obra cinematográfica O Exterminador do Futuro, lançada em 1984, onde robôs controlados por uma inteligência artificial superior lutam contra humanos em um futuro apocalíptico. Jiang Bin enfatiza que uma distopia semelhante àquela retratada no filme poderia, de fato, se tornar realidade, especialmente se o exército americano for concedido acesso irrestrito à IA.

O Departamento de Defesa dos EUA recentemente adicionou a Anthropic à sua lista de empresas que representam um “risco à segurança nacional em matéria de suprimentos”. Essa medida foi adotada em resposta à recusa da empresa em suspender as restrições ao uso de sua tecnologia. Essa inclusão significa que todos os fornecedores devem interromper imediatamente o uso da Anthropic e seu assistente de IA generativa, Claude, em qualquer serviço prestado ao governo.

Implicações e Consequências

- Vigilância em Massa: O uso de IA para monitorar a população levanta questões sérias sobre privacidade e direitos civis.

- Automação de Conflitos: A automação de ações militares pode desumanizar a guerra e levar a decisões apressadas e letais.

- Risco Global: A escalada de conflitos tecnológicos pode resultar em um cenário de guerra cibernética.

Essas implicações não são apenas teóricas, pois já estamos vendo movimentos em direção a uma maior militarização da tecnologia. A combinação de algoritmos sofisticados com operações militares é um campo delicado que requer uma consideração ética aprofundada.

Reflexões Finais

Como sociedade, precisamos ponderar sobre o que significa permitir que a IA tenha um papel tão central em decisões que podem afetar a vida de milhões. A questão não é apenas sobre tecnologia, mas sobre a ética que a envolve e as responsabilidades que vêm junto com seu uso. O futuro da IA nas forças armadas pode moldar não apenas a política externa dos EUA, mas também o futuro de como as guerras são travadas e como a humanidade se relaciona com a tecnologia.

Este é um momento crítico para refletirmos sobre as diretrizes que estamos estabelecendo para o uso da inteligência artificial. Será que estamos prontos para lidar com as consequências de tornar a IA uma parte integral das operações militares? A discussão está apenas começando, e todos devemos estar atentos a esse debate tão relevante.